DeepSeek의 놀랍도록 저렴한 AI 모델 인 DeepSeek V3는 AI 시장을 흔들어 Nvidia의 주가가 크게 감소했습니다. DeepSeek은 단지 6 백만 달러의 교육 비용을 주장하지만 자세히 살펴보면 훨씬 더 많은 투자가 나타납니다.

이미지 : ensigame.com

이미지 : ensigame.com

DeepSeek V3의 혁신적인 아키텍처는 성능의 핵심입니다. 사용합니다.

- MTP (Multi-Token Prediction) : 여러 단어를 동시에 예측하여 정확도와 효율성을 높입니다.

- 전문가 혼합 (MOE) : 256 개의 신경망을 사용하여 각 처리 작업마다 8 개의 활성화, 교육 가속화 및 성능 향상.

- 멀티 헤드 잠재주의 (MLA) : 주요 세부 사항을 반복적으로 추출하여 정보 손실을 최소화하고 뉘앙스 이해를 향상시킵니다.

이미지 : ensigame.com

이미지 : ensigame.com

그러나 Semianalysis는 DeepSeek의 약 50,000 Nvidia Hopper GPU의 사용을 발견했습니다. 이는 총 16 억 달러의 서버와 9 억 9,400 만 달러의 운영 비용이 상당한 투자입니다. 이는 연구, 개선, 데이터 처리 및 인프라를 생략하는 공개 6 백만 달러의 사전 훈련 비용과 크게 대조됩니다.

중국 헤지 펀드 인 High-Flyer의 자회사 인 Deepseek는 데이터 센터를 소유하여 제어력과 더 빠른 혁신을 제공합니다. 자체 자금 지원 상태는 민첩성을 향상시킵니다. 이 회사는 최고의 인재를 유치하며 일부 연구자들은 주로 중국 대학에서 매년 130 만 달러 이상을 벌고 있습니다.

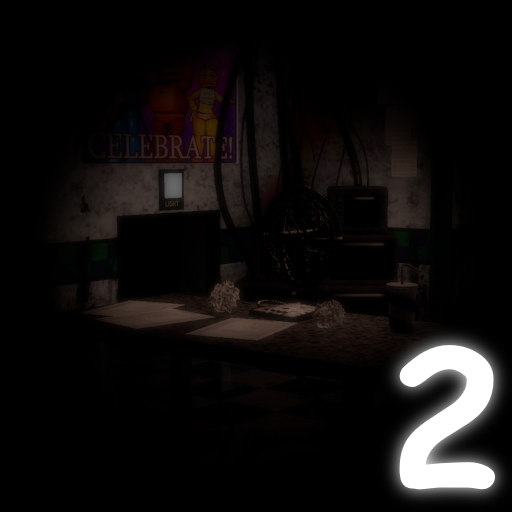

이미지 : ensigame.com

이미지 : ensigame.com

AI 개발에 대한 DeepSeek의 5 억 달러 이상의 투자는 상당하지만, 린 구조는 효율적인 혁신을 허용합니다. 6 백만 달러 규모의 수치는 오해의 소지가 있으며 총 비용의 일부만을 나타냅니다. 그럼에도 불구하고 DeepSeek의 모델 교육 비용은 ChatGPT4O의 약 1 억 달러와 같은 경쟁 업체보다 상당히 낮으며, 업계 거인에 비해 비용 효율성을 강조합니다.

이미지 : ensigame.com

이미지 : ensigame.com

DeepSeek의 성공은 잘 자금을 지원하는 독립 AI 회사의 잠재력을 효과적으로 경쟁 할 수있는 잠재력을 보여줍니다. 그러나 그 성과는 혁신적인 예산이 아닌 상당한 투자, 기술 발전 및 강력한 팀에 뿌리를두고 있습니다.